Linear Algebra - 1.6 Linear Independence and Linear Dependence

- Linear Algebra - 1.1 Systems of Linear Equations

- Linear Algebra - 1.2 Row Reduction and Echelon Forms

- Linear Algebra - 1.3 Vector Equations

- Linear Algebra - 1.4 The Matrix Equation Ax=b

- Linear Algebra - 1.5 Solution Sets of Linear Systems

- Linear Algebra - 1.6 Linear Independence and Linear Dependence

- Linear Algebra - 1.7 Introduction to Linear Transformation

- Linear Algebra - 1.8 The Matrix of a Linear Transformation

- Linear Algebra - 2.1 Matrix Operations

- Linear Algebra - 2.2 The Inverse of Matrix

- Linear Algebra - 2.3 Characterizations of Invertible Matrices of

- Linear Algebra - 2.4 Partitioned Matrices

- Linear Algebra - 2.5 Matrix Factorizations, LU Decomposition

- Linear Algebra - 2.6 Subspaces of $\mathbb{R}^n$

- Linear Algebra - 2.7 Dimension and Rank

- Linear Algebra - 3.1 Introduction to Determinants

- Linear Algebra - 3.2 Properties of Determinants

- Linear Algebra - 3.3 Cramer's Rule, Volume, And Linear Transformations

- Linear Algebra - 4.1 Eigenvectors and Eigenvalues

- Linear Algebra - 4.2 The Characteristic Equation

- Linear Algebra - 4.3 Diagonalization

- Linear Algebra - 4.4 Eigenvectors And Linear Transformations

- Linear Algebra - 4.5 Complex Eigenvalues

- Linear Algebra - 5.1 Inner Product And Orthogonality

- Linear Algebra - 5.2 Orthogonal Sets

- Linear Algebra - 5.3 Orthogonal Projections

- Linear Algebra - 5.4 The Gram-Schmidt Process (그람 슈미츠 과정)

- Linear Algebra - 5.5 Least-Square Problems

- Linear Algebra - 6.1 Diagonalization of Symmetric Matrices

- Linear Algebra - 6.2 Quadratic Forms

- Linear Algebra - 6.3 Constrained Optimization

- Linear Algebra - 6.4 SVD, The Singular Value Decomposition

- Linear Algebra - 6.5 Reduced SVD, Pseudoinverse, Matrix Classification, Inverse Algorithm

용어 정리

- linearly independent (선형 독립)

- linearly dependent (선형 종속)

- sets of one vector (하나의 벡터 집합)

- sets of two vectors (두 벡터의 집합)

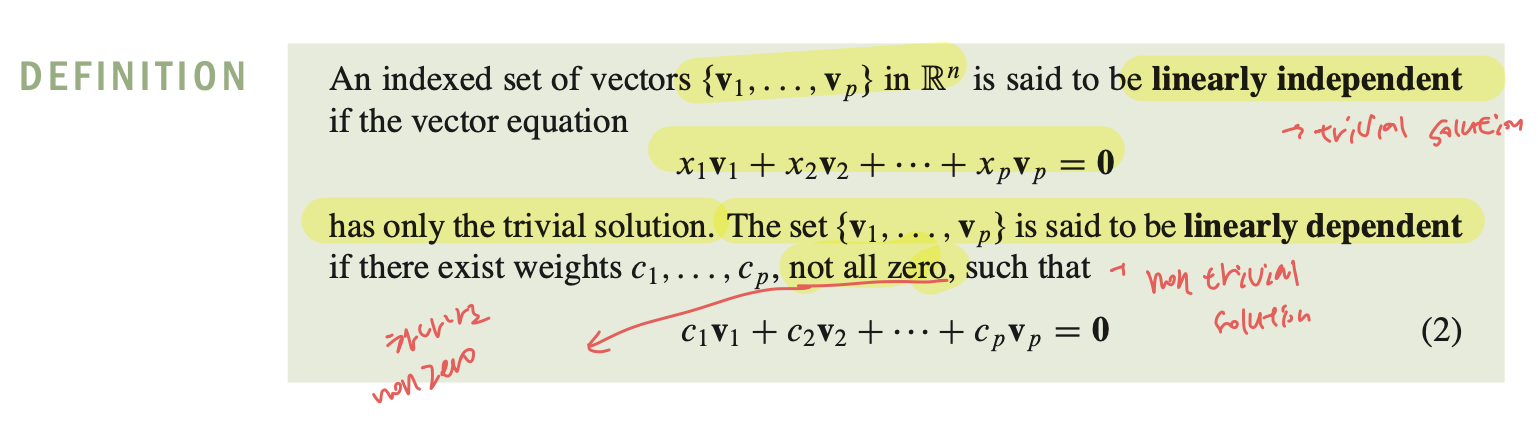

Linearly Independent - 선형 독립

- $ \mathbb{R}^{n} $ 공간에서 vector {$ v_1, \dots, v_p $}가 있을 때 만약 vector equation이 trivial solution 일 때 linearly Independent 하다고 한다.

- 즉, trivial solution 이다 -> free variable 존재하지 않는다 -> linearly independent 하다.

trivial solution만 존재한다는 것은 각 벡터들에 적절한 값을 곱해서 서로 같게 할 때, 결국 0을 곱해서 모두 0으로 만들어서 0 = 0 으로 만드는 방법 외에는 없다는 이야기이다.

Linearly Dependent - 선형 종속

- 벡터 방정식 $c_1v_1 + \dots + c_pv_p = 0$ 에서 weight $c_1, \dots, c_p$ 중 하나라도 nonzero면 linearly dependent라고 한다.

- nontrivial solution을 갖고 있으면 최소 1개가 nonzero, 여러개가 nonzero 일 수 있으므로 linear combination으로 표현되지 않을 수 있다.

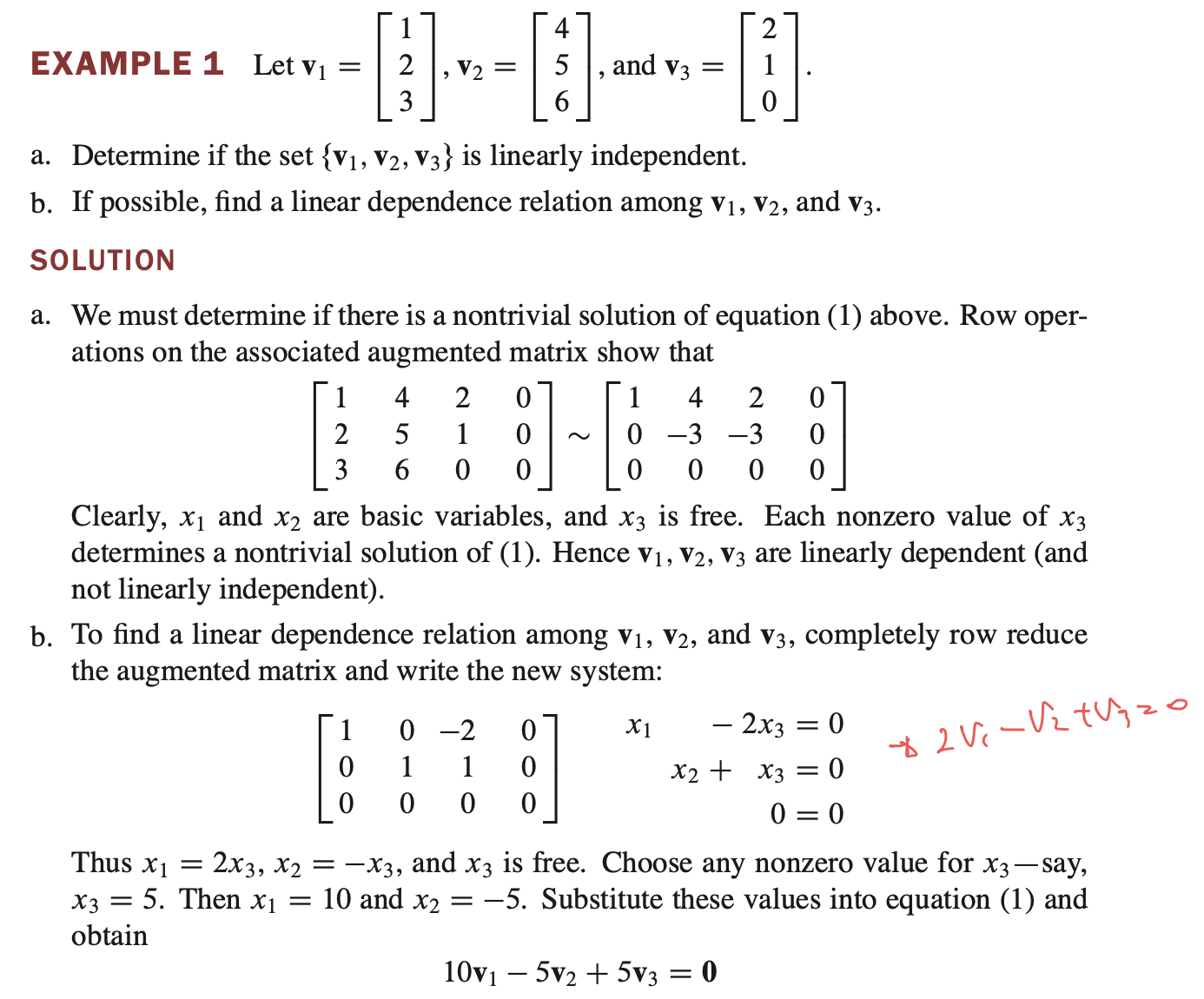

Linearly Independent or Linearly Dependent 판단 예시

trivial solution (free variable 이 없음) 만 확인하면 linear independent 하므로 augmented matrix 로 변환 후 row reduction을 통해 검출해야한다.

- 변수는 $x_1,x_2,x_3$ 3개인데, pivot position이 2개 이므로 free variable 이 존재함을 의미한다.

- 따라서, free variable 이 존재 -> nontrivial solution -> linearly dependent 하다.

- 마지막에 나오는 vector set을 보면, $ 10v_1 - 5v_2 + 5v_3 = 0 $ 임을 확인할 수 있는데 여기서 한 벡터를 우변으로 넘기면

- $ 10v_1 + 5v_3 = 5v_2 $ 어떤 2개의 벡터의 합으로 다른 벡터를 표현이 되는 것을 볼 수 있다. 우리는 이것을 linearly dependent 이라고 한다.

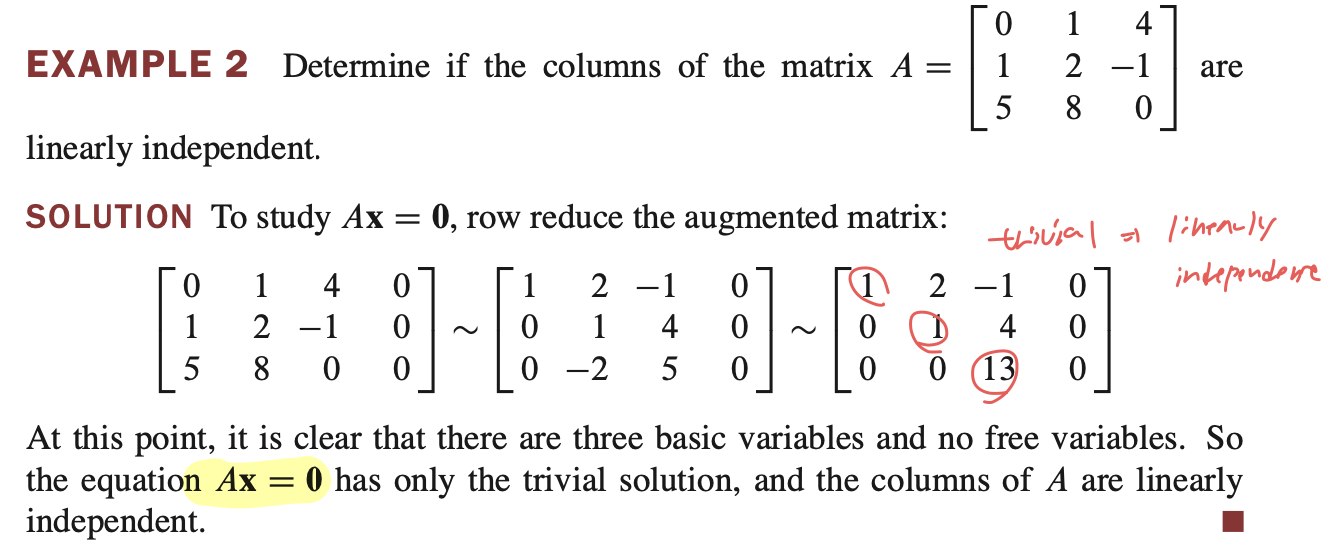

Linear Independence of Matrix Columns - 행렬의 열의 선형 독립

The columns of a matrix $\mathbf{A}$ are linearly independent if and only if the equation $ \mathbf{A}\mathsf{x} = 0 $ has $only$ the trivial solution.

$ \mathbf{A}\mathsf{x} = 0 $ (homogeneous equation)가 trivial solution만을 갖고 있다면 A의 열들은 linearly independent 하다. 즉, A가 linearly independent 하면 $ \mathbf{A}\mathsf{x} = 0 $ 는 trivial solution만을 갖고 있다.

- 예시 문제

$ \mathbf{A}\mathsf{x} = 0 $ 에서 A는 coefficient matrix 를 의미한다.

- 모든 row 에 pivot position이 존재한다.

- free variable 이 없으므로 trivial solution 밖에 없음.

- trivial solution 이므로 linearly independent하다.

Sets of One Vector - 하나의 벡터 집합

- 집합이 하나의 벡터 v 만을 갖고 있고 v 가 0이 아닐 때 linearly independent 하다.

- v = 0이면, $x_1v = x_10 = 0$ 에서 $x_1$은 임의의 값을 갖게 된다. 이는 $x_1$이 free variable 임을 의미한다. 따라서 nontrivial solution이 존재하게 되어 linearly dependent 하게 된다.

- v \ne 0이면, $x_1v = 0$ 에서 0을 만족하려면 $x_1$은 무조건 0이 되어야한다. 따라서 이는 trivial solution 이므로 linearly independent 하다.

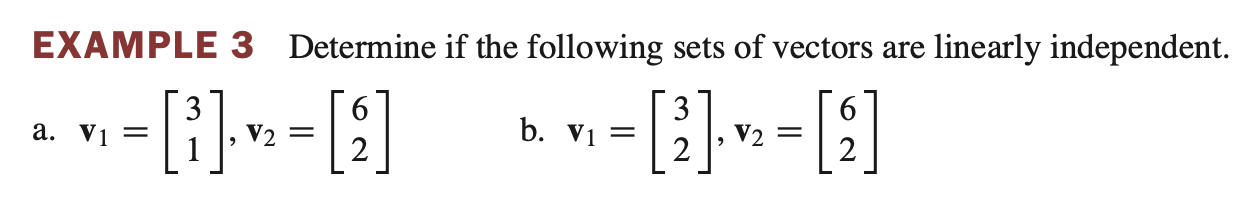

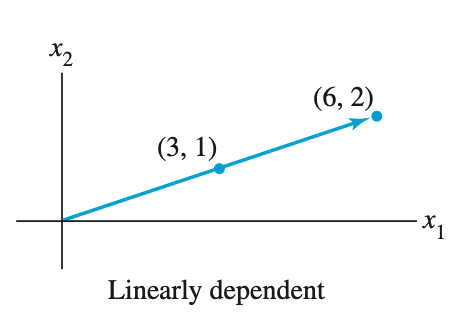

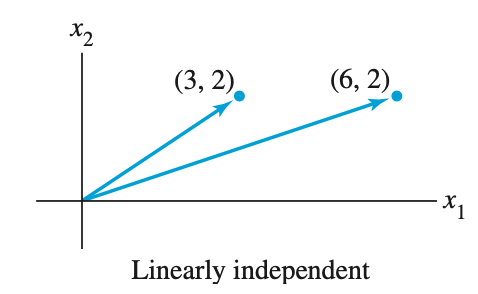

Sets of Two Vectors - 두 개의 벡터 집합

A set of two vectors {$v_1, v_2$} is linearly dependent if at least one of the vectors is a multiple of the other. The set is linearly independent if and only if neither of the vectors is a multiple of the other

예시 문제

- a. 는 scalar multiplication 형태로 표현이 가능하므로 linearly dependent 하다.

- b. 는 scalar multiplication 으로 표현을 못하므로 linearly independent 하다.

- 두 vector의 집합에서 하나의 vector 가 다른 vector 의 scalar multiplication 형태로 표현되면 linearly dependent 하다.

- 두 vector의 집합에서 하나의 vector 가 다른 vector 의 scalar multiplication 형태로 표현되지 않는다면 linearly independent 하다.

Theorem7. Characterization of Linearly Dependent Sets

An indexed set $ \mathbf{S} = $ { $ v_1, \dots, v_p $ } of two or more vectors is linearly dependent if and only if at least one of the vectors in $\mathbf{S}$ is a linear combination of the others. In fact, if $\mathbf{S}$ is linearly dependent and $v_1 \ne \mathbf{0}$, then some $v_j$ (with $j$ > 1) is a linear combination of the preceding vectors $ v_1, \dots, v_{j-1} $.

- 집합 $ \mathbf{S} = $ { $ v_1, \dots, v_p $ } 의 두 개 이상의 vector가 linearly dependent 하다면 $\mathbf{S}$ 에 있는 vector들 중 적어도 하나는 다른 vector들의 linear combination으로 표현할 수 있다.

- 즉, 최소한 하나의 vector가 다른 vector의 linear combination으로 표현가능하면 2개 이상의 vector는 linearly dependent 하다.

- $c_1v_1 + \dots + c_pv_p = 0$ 에서 두 개 이상의 vector가 linearly dependent라고 가정해보자.

- linearly dependent 하므로 하나의 벡터는 다른 벡터의 scalar multiplication 형태로 표현이 가능하다. 따라서 하나의 벡터는 다른 벡터의 linear combination 으로 표현될 수 있다.

- $v_1 = (-c_2 / c_1)v_2 + \dots + (-c_p / c_1)v_p$

- 즉, $v_1 \neq 0$이고 $c_1 \neq 0$이면 $v_1 = (-c_2/c_1)v_2 + \dots + (-c_p/c_1)v_p$ 와 같이 $v_1$을 나머지 벡터들의 linear combination으로 표현할 수 있다.

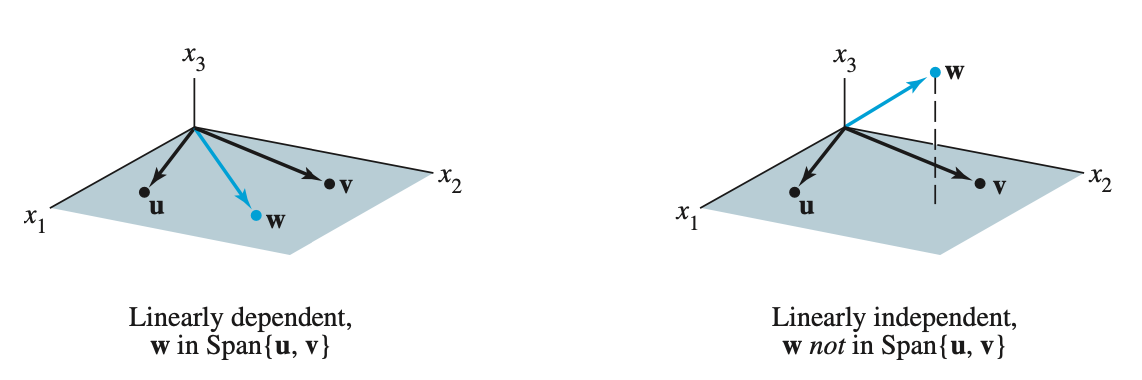

$ \mathbb{R}^{3} $ 공간에서의 {u,v,w}

- u와 v가 linearly independent 할 때, set{u,v,w}가 linearly dependent 하다면 w is in Span{u,v}이다.

w is in Span{u,v}는 Span{u,v}에 w가 존재한다는 의미이다. 즉, u와 v의 linear combination으로 w를 표현할 수 있다.

- 일반화 하자면, S = {u,v,w}가 dependent 하면 $v_j$는 선행 벡터들 $v_1, \dots, v_{j-1}$의 linear combination으로 표현 가능하다 -> w는 u와 v의 linear combination으로 표현 가능하다 -> w is in Span{u,v}이다.

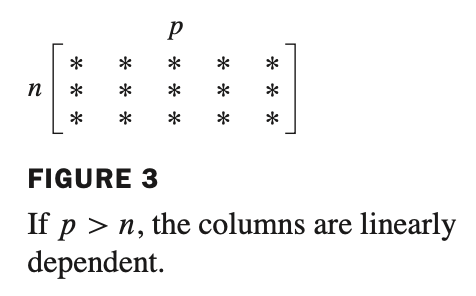

Theorem8.

If a set contains more vectors than there are entries in each vector, then the set is linearly dependent. That is, any set {$v_1, \dots, v_p$} in $ \mathbb{R}^{n} $ is linearly dependent if $ p > n$.

- 예제, $ \begin{bmatrix} 2 \\ 1 \end{bmatrix}, \begin{bmatrix} \phantom{-}4 \\ -1 \end{bmatrix}, \begin{bmatrix} -2 \\ \phantom{-}2 \end{bmatrix} $ 가 linearly dependent 한지 풀어보자.

- 위 set 은 n = 2, p = 3 이므로 1개 이상의 free variable을 갖게 된다. 따라서 nontrivial solution을 갖게 되므로 linearly dependent 하다.

- 정리하자면, free variable의 의미는 infinitely many solution을 의미하고 nontrivial solution을 갖게 되며 linearly dependent를 의미한다.

Theorem9.

If a set $\mathbf{S} = $ {$ v_1, \dots, v_p $} in $\mathbb{R}^{n}$ contains the zero vector, then the set is linearly dependent.

- zero vector 를 포함하는 set은 linearly dependent 하다.

- $v_1$을 zero vector로 가정했을 때 $v_2, \dots, v_p$에 해당하는 coefficient가 0이어도 $v_1$에 해당하는 coefficient는 nonzero 가 될 수 있다.

- $v_1$은 0이므로 $c_1$은 어떤 값을 곱해도 0이 성립하기 때문이다. nontrivial solution을 갖게되므로 linearly dependent를 의미한다.

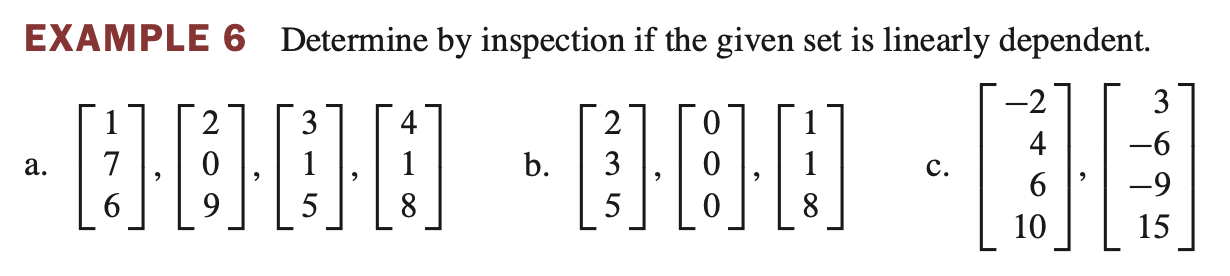

row reduction 없이 linearly dependent 판단 예제

- a. linearly dependent하다. theorem 8 의 $ n < p $

- b. linearly dependent하다. 0 벡터가 존재하므로..

- c. linearly independent하다. scalar multiplication으로 표현되지 않기 때문. (주의: $ n > p $가 항상 independent를 보장하지는 않는다. 여기서는 두 벡터가 scalar multiple 관계가 아님을 직접 확인해야 한다.)