Linear Algebra - 4.4 Eigenvectors And Linear Transformations

- Linear Algebra - 1.1 Systems of Linear Equations

- Linear Algebra - 1.2 Row Reduction and Echelon Forms

- Linear Algebra - 1.3 Vector Equations

- Linear Algebra - 1.4 The Matrix Equation Ax=b

- Linear Algebra - 1.5 Solution Sets of Linear Systems

- Linear Algebra - 1.6 Linear Independence and Linear Dependence

- Linear Algebra - 1.7 Introduction to Linear Transformation

- Linear Algebra - 1.8 The Matrix of a Linear Transformation

- Linear Algebra - 2.1 Matrix Operations

- Linear Algebra - 2.2 The Inverse of Matrix

- Linear Algebra - 2.3 Characterizations of Invertible Matrices of

- Linear Algebra - 2.4 Partitioned Matrices

- Linear Algebra - 2.5 Matrix Factorizations, LU Decomposition

- Linear Algebra - 2.6 Subspaces of $\mathbb{R}^n$

- Linear Algebra - 2.7 Dimension and Rank

- Linear Algebra - 3.1 Introduction to Determinants

- Linear Algebra - 3.2 Properties of Determinants

- Linear Algebra - 3.3 Cramer's Rule, Volume, And Linear Transformations

- Linear Algebra - 4.1 Eigenvectors and Eigenvalues

- Linear Algebra - 4.2 The Characteristic Equation

- Linear Algebra - 4.3 Diagonalization

- Linear Algebra - 4.4 Eigenvectors And Linear Transformations

- Linear Algebra - 4.5 Complex Eigenvalues

- Linear Algebra - 5.1 Inner Product And Orthogonality

- Linear Algebra - 5.2 Orthogonal Sets

- Linear Algebra - 5.3 Orthogonal Projections

- Linear Algebra - 5.4 The Gram-Schmidt Process (그람 슈미츠 과정)

- Linear Algebra - 5.5 Least-Square Problems

- Linear Algebra - 6.1 Diagonalization of Symmetric Matrices

- Linear Algebra - 6.2 Quadratic Forms

- Linear Algebra - 6.3 Constrained Optimization

- Linear Algebra - 6.4 SVD, The Singular Value Decomposition

- Linear Algebra - 6.5 Reduced SVD, Pseudoinverse, Matrix Classification, Inverse Algorithm

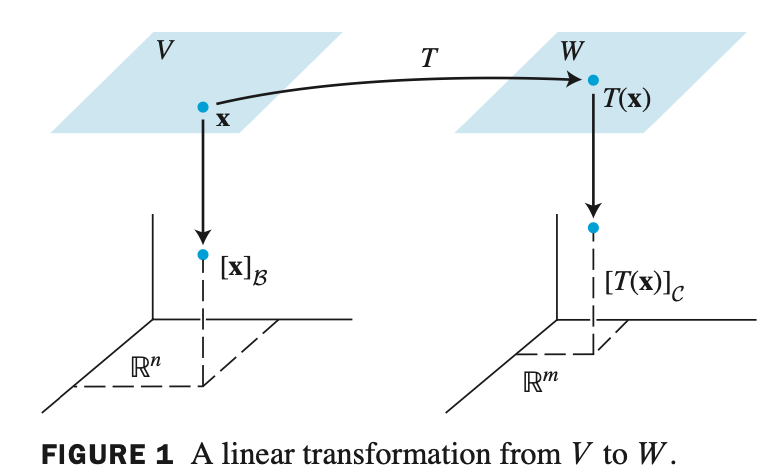

The matrix of Linear Transformation - 선형 변환의 행렬

- $V$ 가 n-dimensional vector space 이고 $W$ 는 m-dimensional vector space 로 주어졌을 때, $V$ 에서 $W$ 로 linear transformation 을 $T$ 로 가정하자.

그러면 $\beta$ basis 로 표현되는 $\mathbf{x}$ 의 coordinate vector \(\left[ \mathbf{x} \right] _{\beta}\) 와 $\mathcal{C}$ basis 로 표현되는 $T(\mathbf{x})$ 의 coordinate vector $[T(\mathbf{x})]_{\mathcal{C}}$ 를 연결시키는 행렬이 있을까?

- \(\left[ \mathbf{x} \right] _{\beta}\) 와 $[T(\mathbf{x})]_{\mathcal{C}}$ 사이의 연결은 쉽게 찾을 수 있다.

- $V$ 에 대한 basis $\beta$ 가 ${\mathbf{b}_1, \dots, \mathbf{b}_n}$ 으로 구성되어 있다면

- $\mathbf{x}$ 는 다음과 같이 정의할 수 있다.

- 따라서 basis $\beta$ 에 대한 coordinate vector \(\left[ \mathbf{x} \right] _{\beta}\) 는 다음과 같다.

- 그리고 $T(\mathbf{x})$ 는 다음과 같이 정의된다.

- basis $\mathcal{C}$ 에 대한 $T(x)$ 의 coordinate vector 는 다음과 같이 구할 수 있다.

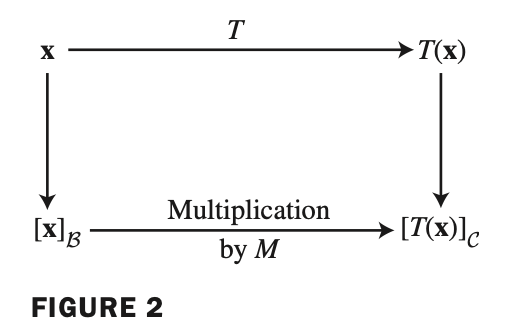

- 이를 행렬 $M$ 을 이용해 간단히 표현하면 다음과 같다.

- 여기서 $M$ 은 다음과 같다.

이 행렬 $M$ 을 bases 인 $\beta$ 와 $\mathcal{C}$ 에 상대적인 $T$ 에 대한 행렬 이라고 부른다.

The matrix $M$ is a matrix representation of $T$, called the matrix for $T$ relative to the bases $\beta$ and $\mathcal{C}$ .

- 예시 문제

- vector space $V, W$ 에 대한 basis $\beta, \mathcal{C}$ 와 $T(b)$ 주어졌을 때, basis $\beta$ 와 $\mathcal{C}$ 에 상대적인 $T$ 에 대한 행렬 $M$ 을 찾는 문제이다.

- $ M = [T(\mathbf{b})]_{\mathcal{C}} $ 이므로 다음과 같이 구할 수 있다.

- 두 벡터의 column 으로 구성된 행렬 $M$ 을 구할 수 있다.

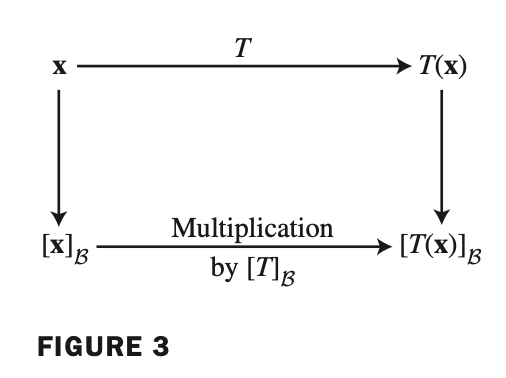

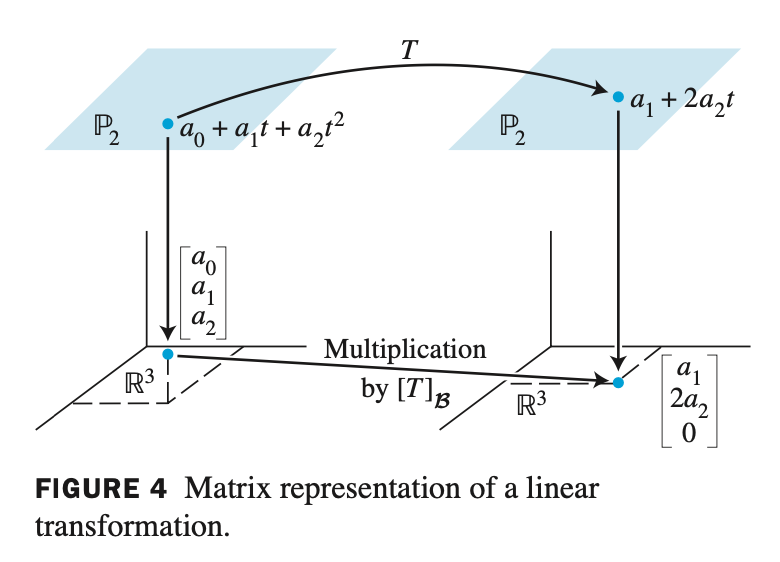

Linear Transformations from V into V - 동일한 벡터 공간에서의 선형 변환

- 동일한 벡터 공간에서 선형 변환은 다음과 같이 정의된다.

- 이를 $\beta$ - matrix for $T$ 라고 간단히 표현한다.

- 예시 문제

- $T$ 가 $P_2 \rightarrow P_2$ 로 mapping 한다고 정의되고 $T(\mathbf{x})$ 는 다음과 같다. (여기서 $P$ 는 polynomial space 를 의미한다.)

- (1) $\beta$ basis 가 ${1, t, t^2}$ 일 때, B-matrix for $T$ 를 찾고 (2) \([T(\mathbf{p})]_{\beta} = [T]_{\beta} [\mathbf{p}]_{\beta}\) 를 증명하는 문제이다.

(1)

- basis vector 를 구하면 다음과 같다.

$ T(1) = 0 \quad \quad $ The zero polynomial

$ T(t) = 1 \quad \quad $ The polynomial whose value is always 1.

$ T(t^2) = 2t \quad \quad $

- $R^3$ space 의 basis 인 ${1, t, t^2}$ 에 대한 coordinate vector 는 다음과 같다.

(2)

- $ [T(\mathbf{p})]_{\beta} $ 는 다음과 같다.

- 결과적으로 우리가 $T$ 를 알고 $[T]_{\beta}$ ($T$ 에 대한 $\beta$ 행렬) 을 알면 coordinate vector 를 알 수 있고 따라서 해당 Transformation 에 대응되는 polynomial 을 찾을 수 있다.

Theorem7. Diagonal Matrix Representation

Suppose $A = PDP^{-1} \; $ , where $D$ is a diagonal $n \times n$ matrix. If $\beta$ is the basis for $\mathbb{R}^n$ formed from the columns of $P$ , then $D$ is the $\beta$ - matrix for the transformation $\mathbf{x} \mapsto A\mathbf{x}$ .

- $D$ 는 diagonal matrix 이고, $A$ 는 diagonalizable 로 가정할 때 basis $\beta$ 는 $P$ 의 column 으로 구성된다. 그리고 $D$ 는 $\beta$ - matrix for $T$ 가 된다.

- 증명

- $P$ 의 column 은 $\mathbf{b}_1 , \dots , \mathbf{b}_n \; $ 이므로 $\beta = {\mathbf{b}_1 , \dots , \mathbf{b}_n} $ 이다.

- 따라서 $P$ 는 change-of-coordinates matrix $P_{\beta}$ 이다. 그러모르 다음과 같은 성질을 만족한다.

- 만약, $T(\mathbf{x}) = A\mathbf{x}$ 이면 다음과 같다.

\([T]_{\beta} = [ [T(\mathbf{b}_1)]_{\beta} \quad \dots \quad [T(\mathbf{b}_n)]_{\beta} ] \quad \quad \quad \quad\) Definition of $[T]_{\beta}$

\(\quad \quad = [ [A\mathbf{b}_1]_{\beta} \quad \dots \quad [A\mathbf{b}_n]_{\beta} ] \quad \quad \quad \quad\) Since $T(\mathbf{x}) = A\mathbf{x}$

\(\quad \quad = [ P^{-1}A\mathbf{b}_1 \quad \dots \quad P^{-1}A\mathbf{b}_n ] \quad \quad \quad \quad\) Change of coordinates

\(\quad \quad = P^{-1}A [\mathbf{b}_1 \quad \dots \quad \mathbf{b}_n ] \quad \quad \quad \quad\) Matrix multiplication

$ \quad \quad = P^{-1}AP $

- $A = PDP^{-1} $ 이므로 $[T]_{\beta}$ 는 다음과 같다.

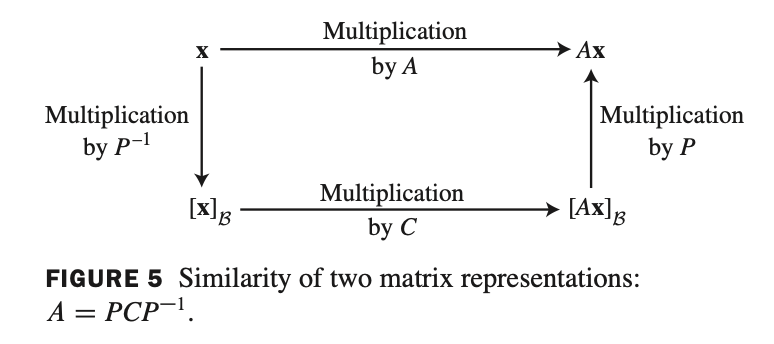

Similarity of Matrix Representations - 행렬의 유사도 표현

- $A$ 와 $C$ 가 similar 하면, $\beta$ - matrix 는 $C$ 이다.

- $C$ 가 꼭 diagonal matrix 가 아니어도 성립한다..

- 예시 문제

- $A$ 와 basis 가 주어지고 $\beta$ - matrix 를 찾는 문제이다.

여기서 $A$ 의 eigenvalue 는 -2 (multiplicity = 2) 이고 eigenspace dimension 은 1이다. 따라서, not diagonalizable 이다.

- $\mathbf{b}_1 , \mathbf{b}_2$ 는 서로 곱의 관계가 아니므로 linearly independent 함을 알 수 있다.

- 따라서 $P$ 를 구할 수 있다.

- $A = PCP^{-1}$ 이므로 $C$ 는 다음과 같이 구할 수 있다.

- $C$ 의 diagonal entries 가 $A$ 의 eigenvalue 가 되고 $\beta$ - matrix 이다.

- $A$ 가 diagonalizable 이 아니더라도 어떤 independent basis 만 선택한다면 $\beta$ - matrix 를 찾을 수 있다. 이때 basis 는 independent set 이어야 한다.